标签: 大模型

数据科学扫盲:从训练到部署大模型LLMs

LLMs具有改变自然语言处理领域的潜力,但训练和改进这些模型需要特定的技能和知识。随着对自然语言处理的需求不断增长,大型语言模型在机器学习和数据科学中扮演着越来越重要的角色。通过了解优化这些模型所涉及的技术和方法,数据科学家可以充分发挥自然语言处理的潜力,构建更高效、更有效的机器学习系统。

10分钟了解大模型应用架构(LLM application architecture)全貌

通过与外部工具的结合和多模型协作,大模型(LLM)能够弥补知识盲点并提高处理效率。通过结构化输出、向量数据库以及记忆和缓存技术的引入,进一步增强了模型的能力和系统的性能。

大模型推荐系统如何高效预训练和推理

从零开始预训练大模型,是非常具有挑战性的事情。由于预训练样本较多(很多模型需要上万亿个token),参数较多,通常需要非常多的计算资源和合适的框架来协助。一般来说,做基础大模型的公司才需要从零开始预训练大模型,而做中间层或者应用的公司可以对开源的大模型进行微调或者直接部署。

什么是多模态大模型?本质和技术难点有哪些?

多模态模型,就是具有多种数据模式的模型,比如同时能够处理文字,图片,视频等多种模态数据的模型。多模态大模型是一种更加强大的生成式模型,当然其技术实现难度也更大。但多模态也可能是人类实现通用人工智能的一种方式。

LLM大模型应用开发框架:LangChain和LangGrap

LangChain 是一种通过在链中执行一系列功能来构建利用 LLM 的应用程序的方法。处理是按顺序执行的,类似于单向道路。LangGraph 是一个独立的库,作为 LangChain 的扩展而开发。

什么是生成式大模型?与大模型有哪些区别?

生成式AI或者说生成式大模型的本质是一种数据表征技术,然后根据表征特点的概率,生成一个最符合当前概率的内容。生成式AI最大的作用就是——创造,通过这种方式可能会让AI具备远超人类本身的创造力。

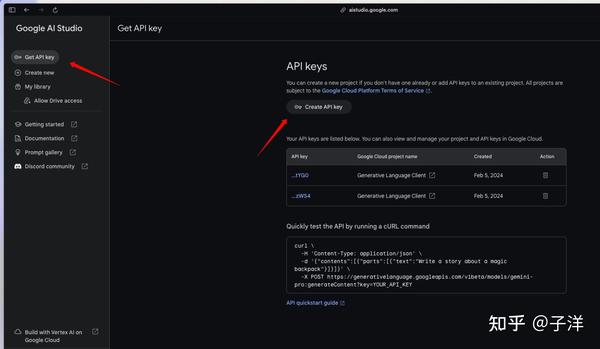

Google AI大模型 Gemini接入指南

Gemimi 介绍

Google 在 2023 年发布的 Gemini 人工智能模型旨在实现真正的通用人工智能。作为一个多模态模型,Gemini 能够跨多种模态无缝对话并提供最佳响应。它是 Googl……

谷歌Gemini 大模型Pro 版本全面使用指南

Gemini 是谷歌推出来对抗OpenAI GPT 的大语言模型,出来也有一段时间了,有朋友私信问如何能用上,今天就给大家分享一下使用指南。实际上Gemini 有3 个不同的版本,Ultra……

文心一言、讯飞星火、ChatGPT大模型的横向比较

文心、讯飞、ChatGPT大模型的横向比较分析发现,大模型最终的优异表现依赖于模型规模的突破。

通过比较不同规模的大模型,分析发现大模型的强大生成能力主要源自模型的参数……

星火认知大模型测评,如何从“AI幻觉”到智能涌现

大模型能否进入生产环境,取决于是否能够从”AI幻觉“过渡到智能涌现。而在这其中,只需要四个核心能力的升级——理解、生成、逻辑和记忆。

自从大模型时代到来以后,大模型……

百度文心大模型如何申请使用

1、注册登录百度云

2、进入百度千帆大模型平台 如果没有申请过百度千帆大模型,可能需要填表申请一下。

申请通过后,在这个页面直接点“立即使用”,就可以进入千帆的控……

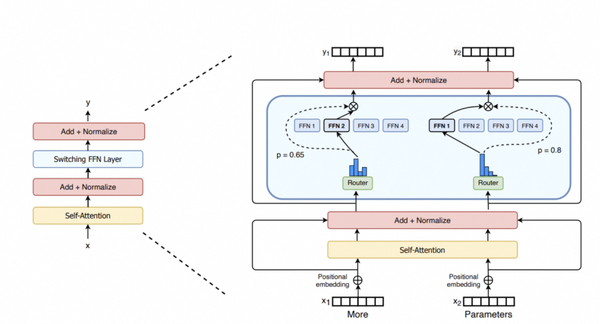

基于Megatron-Core稀疏大模型训练工具:阿里云MoE最佳实践

作者:李鹏1,颜子杰2,王明1,颜海强1,刘振寰2,黄俊1

单位:阿里云人工智能平台PAI1,NVIDIA DevTech Team2

01

概述

随着大模型技术的不断发展,模型结构和参数量级快……

ChatGPT大模型系统实战:AI大模型从何而来?能做什么?

大模型技术从何而来?

在过去的二十多年里,随着AI系统的发展,模型一直在不断增大,所以“大模型”实际上是一个相对的概念。

刚刚提到的基础模型不是凭空出现的,故事还要……

ChatGPT、文心一言、通义千问、讯飞星火测评:AI大模型哪家强?

奇偶派(jioupai)原创

作者 |光尘、叶子

编辑 |钊

图源:图虫创意

2023年是大模型风潮大起的一年,目前市面上,文心一言、讯飞星火、通义千问等诸多国产大模型已经开放……

LoRA(低秩自适应)微调语言大模型的实用技巧

目前,微调定制化LLM会耗费工程师的大量时间和精力,而选择合适的微调方法以及掌握相关技巧可以做到事半功倍。

此前,在《微……

谷歌Gemini大模型放大招,AI界霸主80%性能赶超GPT4

人工智能遇上谷歌,就像一场科技界的大爆炸!最近,谷歌CEO桑达尔·皮查伊宣布了一个令人震惊的消息:Gemini大模型正式上线,这不仅仅是个普通的更新,这是AI领域的一次革……

快速理解 ChatGPT 背后的大模型技术

在过去的十年中,人工智能领域取得了重大突破,其中自然语言处理(NLP)是其重要子领域之一。NLP使用的模型之一是大型语言模型(LLMs)。LLMs被设计用于处理大量文本数……

微调语言大模型选LoRA还是全参数?基于LLaMA 2深度分析

本文对比了全参数微调和LoRA,并分析了这两种技术各自的优势和劣势。作者使用了三个真实用例来训练LLaMA 2模型,这提供了比较特定任务的性能、硬件要求和训练成本的基准……

8款国内AI大模型产品,可合法使用无需翻墙

百度文心一言宣布,将率先开放给大家使用。大家都可以在应用商店下载"文心一言App"或登录"文心一言官网"体验。

根据8月15日正式实施的《生成式人工智能服务管理暂行办法……

从零入门开发推荐系统:chatGPT、大模型介绍

作者 | gongyouliu 编辑 | gongyouliu

自2022年11月30日OpenAI发布chatGPT以来,大模型技术掀起了新一轮人工智能浪潮。chatGPT在各个领域(包括对话、摘要、内容……

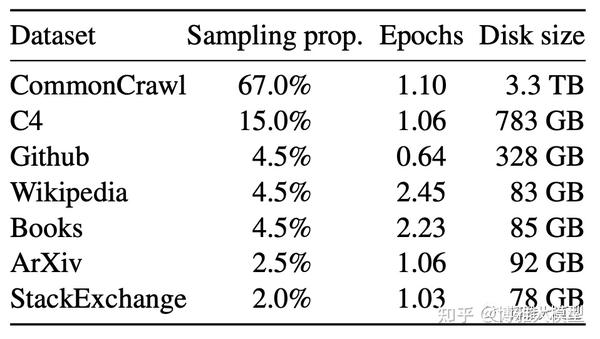

走近大模型:ChatGPT是如何构造和清洗数据的?

数据是基础是现在LLM从业人的共识,尤其是高质量的数据。根据ChatGPT不同阶段的训练过程,数据也分为预训练数据(GPT)和指定微调数据(SFT,RLHF),前者用自回归的方式……

语言大模型工作原理:内部究竟是如何工作的?

语言大模型内部究竟是如何工作的?本文用最少的数学知识和术语进行解释。本文作者Tim Lee曾任职科技媒体Ars Technica,他近期推出了一份Newsletter《Understanding AI》……

大模型颠覆搜索:谷歌宣布开放生成式搜索平台AI

搜索引擎,可能真的要变天了!

Google 终于要迎来它 25 年来最大的改变,谷歌宣布了开始内测开放【生成式搜索平台(Search Generative Experience,SGE)】,并逐步舍弃……

State of GPT:OpenAI官方第一次分享大模型内部原理和RLHF训练细节

来源 | web3天空之城

OpenAI的创始成员,前特斯拉高级 AI 总监 Andrej Karpthy 刚在微软 Build 2023 开发者大会上做了专题演讲:State of GPT(GPT 的现状)。 在这个朴……