comfyUI工作流+LCM,实现实时文生图

介绍使用comfyUI的文生图工作流加LCM,实现实时文生图。

准备ComfyUI

参考comfyUI 页面介绍,安装python环境后一步步安装相关依赖,最终完成comfyUI的安装。相关过程需要对python语言及pip安装有一定的了解。具体安装步骤本文不再详细介绍,如有需要您可以自行搜索解决。如果你是windows用户,你也可以在comfyUI的项目介绍中直接下载打包好python环境的包,解压后尝试运行。如果您如果您的电脑上安装好了comfyUI,那么可以进入下一步加载工作流及视频,开始生成。

如果您是普通用户,不想自己一步步的安装python环境及相关软件,那么您可以从tensorbee 官网下载安装tensorbee, 也可直接点击 下载链接 进行下载。tensorbee安装好后,在tensorbee 中点击下载它的 ComfyUI-LCM, tensorbee将会为您配置好comfyUI的工作环境,和本文的使用的工作流,您只需要点击prompt queue,在文本框内输入文字,即可体现实时文生图。

tensorbee 用户请跳过下一节内容,有兴趣的话直接看效果即可。

加载工作流并设置参数

下载以下含工作流的图片

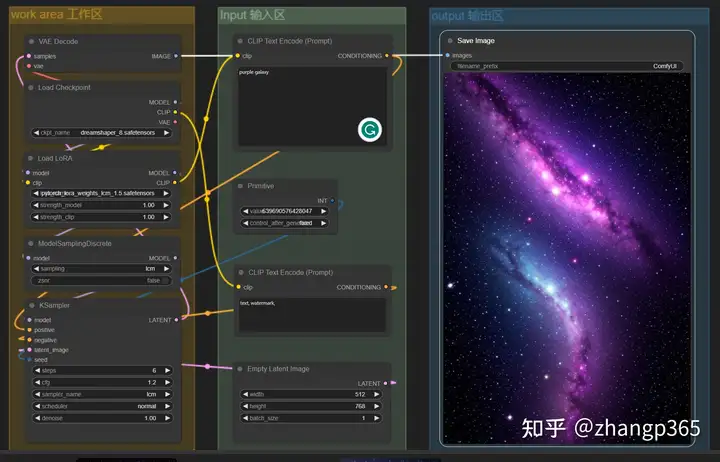

使用右侧的load按钮,加载上面的图片,即可获取以下工作流:

下载模型和Lora

推荐下载 dreamshaper 模型,您也可使用其他sd1.5模型。

lcm_sd1.5_lora:latent-consistency/lcm-lora-sdv1-5放到loras目录

设置参数

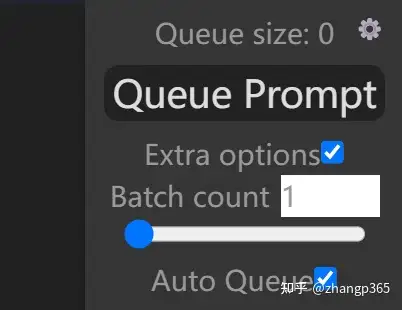

点击右上方 Queue Prompt 下方的Extra options,使之勾选。继续勾选下方的AutoQueue,最后点击Queue Prompt,开启自动队列。

实时文生图

此时回到工作流中间的prompt输入模型,输入对应的文字,即可体验实时文生图。笔者在3070ti上体验的效果如下:

注意, 以上视频由于录屏与生成使用同一块显卡,导致反应速度要慢于正常。不录屏的速度还要快1.5倍。